| 类型 | 来源 | 标题 | 日期 | 相关性 |

|---|---|---|---|---|

| 产品功能 | CSDN博客 | 毕业党福音!这款AI工具让我从论文苦海中提前上岸 | 2026-04-08 | ⭐⭐⭐⭐⭐ |

| 产品评测 | CSDN博客 | “论文降重”利器“笔墨AI”深度解析 | 2026-04-07 | ⭐⭐⭐⭐⭐ |

| 产品官网 | cxgn.cn | 笔墨写作介绍页 | 2026-03-15 | ⭐⭐⭐⭐⭐ |

| 功能介绍 | newyx.net | 笔墨写作安卓版介绍 | 2026-01-06 | ⭐⭐⭐⭐ |

| 技术原理 | 华为云博客 | AI写作底层原理 | 2026-02-24 | ⭐⭐⭐⭐ |

| 技术趋势 | 数栈 | 生成式AI核心技术 | 2026-03-26 | ⭐⭐⭐⭐ |

| 面试指南 | 水利英才网 | AI面试回答方法论 | 2026-02-12 | ⭐⭐⭐⭐ |

| 竞品对比 | 什么值得买 | 四款主流AI公文写作软件对比 | 2026-04-02 | ⭐⭐⭐ |

笔墨AI写作助手实战指南:从入门到底层原理(2026年4月)

本文发布于2026年4月10日,面向技术学习者、在校学生及备考开发者,系统讲解笔墨AI写作助手的功能原理与使用要点。

又是一年毕业季与年中总结季,论文查重、公文撰写成了不少人的心头之痛。如果你还在为“如何降低查重率”“如何写出规范的述职报告”“如何避免被AI检测工具误判”而烦恼,那么你一定需要了解一款正在论文圈和公文圈里被口口相传的智能写作工具——笔墨AI写作助手。它并非普通的文本生成器,而是一套贯穿写作全周期的智能解决方案,覆盖从选题到定稿、从降重到润色的完整流程-2。本文将带你从零开始,系统了解笔墨AI写作助手的核心功能、技术原理,并梳理相关面试要点,帮助你在技术学习和职业发展中建立完整的知识链路。

一、痛点切入:写作路上的三大“拦路虎”

在深入介绍笔墨AI写作助手之前,我们先来看看写作过程中的真实痛点。如果你经历过以下任一场景,说明你正是这款工具的目标用户。

场景一:论文查重与AI检测的双重焦虑

2026年的毕业生面临的是双重“地狱模式”——既要过查重关,又要过AI检测关。知网、维普、万方等系统会标注重复内容,而Turnitin、GPTZero等工具则会识别AI生成痕迹-2。更尴尬的是,有些自己一个字一个字敲出来的内容,因为表达过于“工整”,反而被系统误判为AI写作。

传统降重方式的局限——简单同义词替换def traditional_rewrite(text): 简单的同义词映射 synonyms = {"重要": "关键", "提高": "提升", "明显": "显著"} for word, repl in synonyms.items(): text = text.replace(word, repl) return text 问题:仅替换词汇,语义结构不变,AI检测算法依然能识别这种简单粗暴的同义词替换,不仅无法通过语义层面的AI检测,反而可能越改越糟。

场景二:公文写作的格式“雷区”

对于公务员、国企员工而言,述职报告、工作总结等公文有严格的格式规范要求——标题字体字号、段落间距、编号方式、落款位置都有明确标准,一个细节出错就可能被退回重写-3。

场景三:从零开始的“空白恐惧”

对着空白文档发呆是每个写作者的噩梦。构思结构、梳理逻辑、填充内容……每一步都需要大量时间和精力。据实测,一篇标准结构的学术论文从零开始撰写,平均需要数十个小时,其中大量时间耗费在框架搭建和格式调整等机械性工作上-2。

这些痛点的核心在于:传统写作工具缺乏对语义深度理解和规范适配的能力。笔墨AI写作助手的出现,正是为了解决这些问题。

二、核心概念讲解:笔墨AI写作助手的双重核心

2.1 概念一:智能降重——超越同义词替换的语义重组

标准定义:智能降重是笔墨AI写作助手的核心技术功能之一,它通过深度分析文本的语义结构,对表述方式进行合理化重组,在保持原意不变的前提下降低与其他来源的重复率。

拆解关键词:

语义分析:不只看字面词汇,而是理解句子想表达的意思

语义重组:用不同的句式结构和表达方式重新组织同一意思

保留原意:在降低重复率的同时确保核心信息不丢失

生活化类比:如果把写文章比作做菜,传统降重是“换调料”——把盐换成酱油,味道变了;而笔墨AI的智能降重是“换烹饪方式”——同样的食材,把炒菜变成蒸菜,保留了营养和风味,但菜品完全不同。

核心价值:深度适配知网、维普、万方等主流查重系统的算法逻辑,将“疑似剽窃”但实为原创的表述进行合理化改写,有效减少误判-2。

2.2 概念二:降低AI检测率(去AI味)——让文字回归“人类感”

标准定义:降低AI检测率是笔墨AI写作助手的另一核心功能,它通过调整文本的语言特征、打乱过于顺畅的逻辑节奏,增加人类写作特有的“不确定感”和语序微调,从而显著降低被AI检测工具识别为机器生成的风险-2。

为何需要它:大语言模型(Large Language Model,LLM)生成的文本通常具有高度流畅、句式规整、逻辑线过于清晰的特点。AI检测工具正是捕捉这些“特征”来判断内容是否为AI生成。去AI味的本质,是在保持质量的前提下,让文本回归人类写作的自然状态——包括偶尔的语序微调、语气变化、个人化表达等。

简单示例说明运行机制:

AI生成的文本特征:过度流畅、句式规整ai_text = """鉴于当前经济形势的复杂性,建议采取以下三方面措施:第一,加强宏观调控力度;第二,优化产业结构布局;第三,提升科技创新能力。""" 笔墨AI去AI味后的效果:打破节奏,增加“人类感”humanized_text = """说实话,现在的经济形势确实复杂。我觉得可以从三个角度入手:一个是要把宏观调控做得更到位;产业结构这块也得优化优化;还有科技创新的能力,得加把劲提升上去。"""

三、关联概念讲解:大语言模型——笔墨AI的“智慧大脑”

3.1 大语言模型的标准定义

大语言模型(Large Language Model,LLM) 本质上是一个在海量文本数据上训练出来的概率计算系统。它并非“作家”或“思想者”,其核心任务只有一件事:在给定文本的情况下,计算“下一个最可能出现的词”-16。

3.2 大语言模型与笔墨AI的关系

这是理解笔墨AI写作助手技术原理的关键:大语言模型是“引擎”,笔墨AI写作助手是基于引擎开发的“整车” 。

| 维度 | 大语言模型(LLM) | 笔墨AI写作助手 |

|---|---|---|

| 角色定位 | 底层技术基础 | 上层应用产品 |

| 功能范围 | 通用文本生成与理解 | 垂直领域写作辅助(公文、论文) |

| 输出特点 | 通用型回答 | 适配特定规范(格式、风格、术语) |

| 用户交互 | 对话框直接对话 | 引导式输入+模板套用 |

笔墨写作接入了DeepSeek-R1等定制化大模型技术,在此基础上进行垂直领域优化,包括公文写作规范适配、专业术语库、模板体系等-8。

3.3 大语言模型的概率预测机制

大语言模型的核心机制是Next Token Prediction(下一个词预测) -16。

简化的概率预测机制示意class SimpleLM: def predict_next_token(self, context): """ 根据上下文预测下一个最可能的词 本质:计算所有候选词的条件概率,选择概率最高的 """ 在训练数据中学习到的统计规律 P(词 | 上下文) = 该词在训练数据中出现的概率 probabilities = { "刀": 0.45, 45%概率 "剑": 0.35, 35%概率 "手机": 0.12, 12%概率 "钥匙": 0.08 8%概率 } return max(probabilities, key=probabilities.get)为什么AI会“看似懂逻辑” :模型并不是真的理解了因果关系,而是通过学习大量文本中的结构模式(如“冲突→升级→爆发→反转”等故事结构),学会了“故事通常长这样”。这是一种统计模拟,而非真正的理解-16。

四、概念关系与区别总结

理清了上述概念之后,我们可以用一句话高度概括:大语言模型提供了“能写”的能力,笔墨AI写作助手在此基础上赋予了“会写”的能力——知道在什么场景下该怎么写,以及如何写得像真人。

大语言模型 → 笔墨AI写作助手:底层技术 → 上层应用

概率预测 → 智能降重/去AI味:通用能力 → 专项优化

LLM的“流畅性” → 去AI味的“人类感” :问题根源 → 解决方案

五、代码/流程示例:笔墨AI写作助手的使用流程

下面以一个“述职报告撰写”场景为例,展示完整的使用流程。

步骤1:选择文稿类型

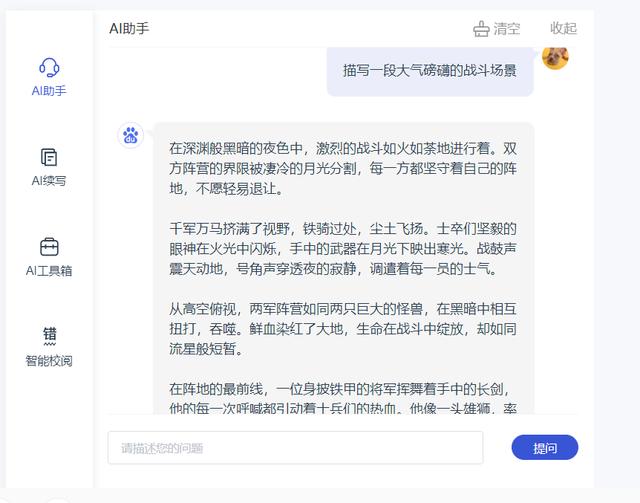

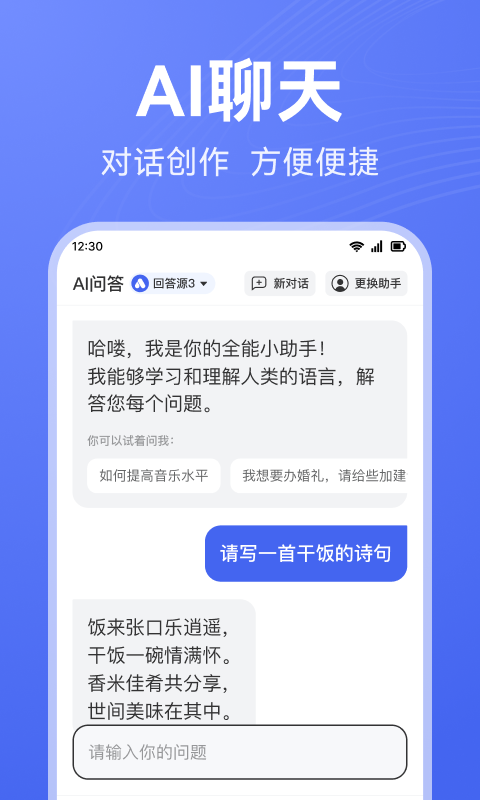

进入笔墨写作官网或App,根据需求选择创作类型。功能涵盖述职报告、工作总结、心得体会、调研报告等各类常用公文-3。

步骤2:输入关键信息

输入文稿的核心主题、适用场景、岗位相关等关键信息。例如撰写述职报告时,填写工作岗位、主要工作内容、本年度重点成果等。

步骤3:AI生成初稿

提交后,系统基于定制化大模型技术快速生成内容。在公文写作场景下,30秒即可生成万字规范文本,专业用词和规范性能达到98%以上-1。

伪代码:笔墨AI的生成流程示意def generate_document(user_input): 1. 理解用户意图(岗位、场景、主题) intent = parse_intent(user_input.topic, user_input.scene) 2. 匹配模板库 template = match_template(user_input.document_type) 3. 调用大语言模型生成内容 raw_content = llm_generate( prompt=template.prompt, context=user_input.details, max_tokens=10000 ) 4. 应用“去AI味”优化 humanized = remove_ai_trace(raw_content) 5. 套用格式模板 formatted = apply_format_template(humanized, template.style) return formatted

步骤4:校对润色与格式排版

对生成的文稿进行错别字修正、逻辑梳理和表达优化。内置符合国标和各大高校要求的模板,可一键生成规范的参考文献列表和目录,十秒完成传统需要两天的手动排版工作-1。

六、底层原理/技术支撑

笔墨AI写作助手的底层技术体系主要包括以下几个层面:

6.1 Transformer架构与自注意力机制

笔墨AI写作助手所依赖的大语言模型基于Transformer架构,其核心是自注意力机制(Self-Attention) ——能够在处理一个词时,同时“关注”到句子中其他词的信息,从而理解上下文关系。这种架构使得模型能够捕捉文本中的长距离依赖关系,理解前后文的连贯性-22。

6.2 预训练与微调的两阶段训练

生成式AI模型通常采用预训练(Pre-training) 和微调(Fine-tuning) 的两阶段方法:预训练阶段使用海量通用文本数据进行无监督学习,让模型掌握语言的基本规律;微调阶段针对公文写作、学术论文等特定场景进行专项优化,使输出内容更贴合垂直领域的规范要求-22。

6.3 垂直领域适配

笔墨AI相比通用AI写作工具,更聚焦国内公文类文稿创作场景,深度适配公职人员、事业单位、国企、学校、医院等多类机构用户的写作规范要求。这意味着它在生成述职报告时,不仅内容逻辑清晰,连标题字体、段落间距、编号方式都符合官方标准-3。

七、高频面试题与参考答案

以下是AI写作相关岗位面试中常见的几道题目,供备考者参考。

问题1:大语言模型生成文本的原理是什么?

参考答案(建议记忆框架:本质+机制+举例):

大语言模型本质上是一个在海量文本数据上训练出来的概率计算系统,其核心机制是Next Token Prediction——在给定上下文的情况下,计算下一个最可能出现的词的概率分布,然后选择概率最高的词。整篇文章就是这样一步步“预测”出来的。例如输入“今天天气”,模型会计算“很好”“不好”“热”等词的概率,然后选择概率最高的输出。这不是真正的“理解”,而是基于统计规律的语言模拟-16。

问题2:AI检测工具是如何识别AI生成文本的?

参考答案:

AI检测工具通过捕捉AI生成文本的统计特征进行识别,主要包括:(1)过度流畅性——AI文本的连贯度通常高于人类写作;(2)句式规整度——AI倾向于使用标准句式结构;(3)词汇多样性——AI在词汇选择上存在特定模式;(4)逻辑线的清晰程度——AI文本的逻辑过渡通常过于“完美”。笔墨AI的“去AI味”功能正是通过打破这些特征来降低检测率——增加语序微调、调整逻辑节奏、引入人类写作特有的“不确定感”-2。

问题3:面试中如何回答“如何利用AI提升工作效率”?

参考答案(建议按“痛点→工具→操作→价值”四步法组织):

首先定位岗位的核心低效点,例如“我了解到这个岗位日常需要撰写大量工作总结,这类工作重复度高且对格式有严格要求”;然后明确工具选型,“我会选择笔墨AI这类垂直写作工具,因为它深度适配公文的格式规范和术语体系”;接着描述具体操作,“输入主题和关键信息后,AI可在30秒内生成符合规范的初稿,我再根据实际数据进行个性化调整和逻辑优化”;最后量化价值,“这样可以将初稿撰写时间从3小时压缩到30分钟,同时确保格式100%符合规范要求,把精力集中在内容深度上”-28。

八、结尾总结

本文系统梳理了笔墨AI写作助手的核心功能、技术原理和使用方法,重点回顾以下知识:

核心痛点:论文查重+AI检测+格式规范+空白恐惧

核心功能:智能降重(语义重组)+降低AI检测率(去AI味)+极速出稿+格式一键排版

技术原理:大语言模型的概率预测机制 → Transformer架构 → 预训练+微调 → 垂直领域适配

易错提醒:不要完全依赖AI生成的内容,AI写的是底稿,经过个人思考与修改的才是属于自己的作品-33

关于底层原理的深入探讨(如自注意力机制的具体实现、模型微调的技术细节等),我们将在后续文章中继续展开。如果你对某个具体话题感兴趣,欢迎留言交流。

扫一扫微信交流

扫一扫微信交流