智慧助手AI助手怎么用?这个问题正成为2026年AI应用领域最受关注的话题之一。DeepSeek凭借百万Token超长上下文、MoE稀疏架构及极致的性价比,在技术圈掀起热潮-1-54。然而很多开发者和学习者在实际使用中却面临共同困境:网页端和API接入搞不清区别、提示词怎么写都不精准、专家模式和快速模式不知如何选择、底层原理更是一知半解。本文将带你从零基础开始,完整掌握DeepSeek的使用方法,并深入其架构原理与面试考点。

一、痛点切入:为什么你需要系统学习DeepSeek的使用方法?

传统大模型使用存在三大典型痛点:提示词描述模糊导致输出与预期严重偏离、模型能力被单一调用方式限制而无法触及完整功能集、不懂底层原理导致代码调试和面试应答举步维艰。不少开发者花了数小时写提示词,模型却始终无法理解真正意图——不是模型不够强,而是没有用对方法。DeepSeek的设计初衷正是要解决这些问题:通过“快速/专家”双模式分层降低使用门槛,通过兼容OpenAI SDK的API降低开发者集成成本-1-12。

二、快速上手:网页端和App端入门操作

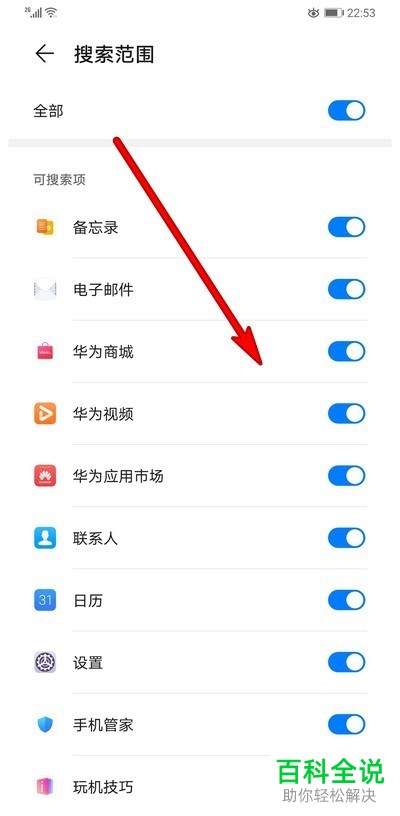

网页端是最直接的入门方式。访问 https://chat.deepseek.com ,支持手机号验证码、微信快捷登录和邮箱注册三种方式-1。登录后在模型列表中选择V4版本即可开始对话。实用配置建议:在系统消息中写一条提示约束输出风格,例如“直接回答,引用假设,如果你在猜测请说出来”,能有效避免模型过度解释;温度调节方面,起草规范或代码注释时保持在0.2左右,需要创意措辞时可调高至0.5-1。App端使用更简单——在应用商店DeepSeek,认准开发者为深度求索,下载安装后完成登录即可-1。2026年4月8日,DeepSeek上线了“快速模式”与“专家模式”,快速模式适合日常对话、即时响应,支持图片和文件文字识别(最多50个文件,每个100MB),专家模式专攻复杂推理,目前仅支持文字输入,高峰时需排队等待-41-50。需要联网实时信息时,记得手动开启输入框附近的联网开关-1。

三、API接入:开发者的集成方案

如果需要在应用中集成DeepSeek,API是最稳定、可控的方案。获取API Key只需三步:访问 https://platform.deepseek.com 注册账号(新账号通常赠送500万免费Token额度),登录后在API Keys页面创建密钥并立即保存-1。DeepSeek API兼容OpenAI SDK格式,切换成本极低,Python调用示例代码简洁明了-1。在华为云AgentArts或阿里云MaaS等平台上,还可以将DeepSeek作为自定义模型接入,创建问答助手智能体-2-3。基于开源Agent平台Dify,DeepSeek可快速构建智能客服、知识库问答和个性化推荐系统-3。这些企业级方案已广泛应用于智能客服、垂直领域咨询及AI Agent开发等场景。

四、核心概念:DeepSeek V4的技术架构

DeepSeek V4是深度求索推出的新一代大语言模型,支持百万Token超长上下文、多模态理解与生成,提供网页聊天、API和本地部署三种使用方式-1。其核心架构可以类比为一支特种部队:MoE(Mixture of Experts)相当于将任务按专业类型分派给不同领域的专家,只有“被激活的专家”参与计算,从而大幅提升效率-54。DeepSeek-V3拥有671B总参数,但每次推理仅激活约37B参数——就像一家大公司每次开会只叫上最相关的部门,既保证了专业性又控制了运营成本。

五、关联概念:快速模式 vs 专家模式

2026年4月上线的“快速模式”与“专家模式”,是DeepSeek首次在产品端引入模式分层设计-12。两个模式的差异体现在三个层面:首先是模型参数量差异——快速模式背后运行的模型参数量较小(或量化程度更高),专家模式则调用更大模型(据实测为DeepSeek-V3.2)-12;其次是输出逻辑差异——快速模式在提示词前自动插入隐藏约束(如“用通俗大白话回答”“先总结再展开”),输出结构固定、响应迅速,专家模式自由选择表格、代码块或长段落输出,思考过程更长但上限更高-12;第三是温度参数差异——快速模式温度固定在0.3左右,输出确定性极高,专家模式温度在0.5-0.9之间动态调整,更具创造性但也可能跑偏-12。简单来说:日常对话、图片识别、快速查询用快速模式,复杂逻辑、代码调试、深度分析请出专家模式。

六、代码示例:用提示词工程提升输出质量

提示词质量直接决定AI输出效果。一个精准的提示词能让输出质量提升300%,而平庸的提问只能得到敷衍的回答-。以下是经过验证的高效提示词模板:

示例一:代码审查任务

你是一位有5年Python后端开发经验的工程师。 分析以下Flask路由代码是否存在SQL注入风险。 仅输出风险点编号、位置行号、修复建议三部分,每项占一行,不使用markdown。 示例输出: 1. 风险点:字符串拼接SQL 2. 位置行号:第12行 3. 修复建议:改用parameterized query

该模板采用了“角色-任务-约束-示例”四元结构化框架,实测可使专业领域回答准确率提升32%-16。

示例二:思维链引导(Chain-of-Thought)

分析步骤: 1. 提取函数所有输入参数类型 2. 检查各参数是否参与边界计算 3. 标识未做空值校验的参数 请严格按上述编号顺序作答,每步结论独占一行。

思维链策略在代码调试、逻辑校验等任务中,错误定位准确率可达89%-16。利用键值对格式化参数配置(如{"task": "text_generation", "output": "code"})可使模型理解效率提高25%-16。

七、底层原理:Engram与mHC架构的技术突破

DeepSeek的强大性能源于两个关键架构创新。Engram(记忆痕迹模块) 将“事实性记忆”从连续神经计算中剥离,转向确定性查找——输入被切分成N-gram片段后,通过哈希映射直接定位到巨大的Lookup Table,查找复杂度仅为O(1)-23。这就好比把常用电话号码写在电话本上而不是每次重新推算一遍:MoE解决的是“参数规模≠计算量必须线性增长”,而Engram在此基础上进一步实现了“条件查找”维度的稀疏性-23。

mHC(流形约束超连接) 则是2026年1月发布的底层架构论文。传统ResNet残差网络面临“信息坍塌”与扩展性受限的问题,mHC通过引入“流形”这一数学结构对梯度流动进行约束,在训练中维持梯度稳定同时避免状态膨胀-21-22。在270亿参数模型上,mHC仅增加约6.7%的训练时间开销即可实现显著性能提升-21。这两个架构共同奠定了DeepSeek V4底层根基,理解了它们才算真正懂得智慧助手AI助手怎么用。

八、高频面试题与参考答案

问题1:DeepSeek的MoE架构与ChatGPT的Dense架构有何本质区别?

DeepSeek采用稀疏MoE架构,总参数671B但每次仅激活约37B参数(激活率约5.5%),ChatGPT的GPT-4o采用稠密Transformer架构,约1.8T参数全激活。MoE优势在于算力成本低——DeepSeek训练成本仅约550万美元,而GPT-4系列需超1亿美元。劣势在于MoE路由机制设计复杂,跨专家负载均衡需额外优化-54。

问题2:如何设计生产级的DeepSeek + Agent系统架构?

推荐四层架构:接入层(API Gateway做鉴权、限流、灰度路由)→ 编排层(Agent状态机:Plan→Act→Observe→Retry/Exit,统一Tool Registry)→ 能力层(模型按任务类型路由、短期+长期记忆分离)→ 治理层(全链路Trace、安全策略、成本看板)。避免把Prompt当作系统设计而忽略治理监控-30。

问题3:专家模式和快速模式的技术差异是什么?

主要体现在三方面:参数规模不同(快速模式模型参数量更小,专家模式调用DeepSeek-V3.2);温度参数不同(快速模式固定在0.3,输出高确定性;专家模式在0.5-0.9动态调整,更具创造性);上下文窗口不同(快速模式通常128K-256K,专家模式扩容至1M)。本质区别在于快速模式优先响应速度,专家模式优先推理深度-12。

九、总结与进阶预告

本文系统讲解了智慧助手AI助手怎么用——从网页端和API接入的入门操作,到快速/专家模式的选择策略,再到提示词工程优化方法,最后深入Engram和mHC底层架构。核心知识点一图总结:网页/API端入门 → 双模式分层选择 → 四元提示词框架 → MoE/Engram/mHC架构支撑。2026年大模型竞争已从“参数规模”转向“效率与成本”,DeepSeek正是这条赛道的领跑者。下一篇我们将深入讲解基于DeepSeek的RAG系统构建与Agent编排实战,敬请期待。

扫一扫微信交流

扫一扫微信交流